每经记者|兰素英 宋欣悦 每经编辑|兰素英

估值3800亿美元的AI独角兽Anthropic一夜之间被特朗普和五角大楼拉进了“黑名单”。

当地时间2月27日(周五),特朗普一声令下要求全美 *** 机构停用其技术,五角大楼更是将其列为国家安全供应链风险,这场因拒绝AI军事应用的“硬刚”,让这家公司与美国官方的合作彻底破裂。

同时,近一个月,Anthropic在资本市场连续掀起风暴。它25天四度发布新品“血洗”美股软件股,成为让IBM、汤森路透等巨头市值暴跌的“AI灭霸”。另一边,它高调指控中国AI企业“技术窃取”,自身却背着15亿美元版权侵权的“黑历史”,遭马斯克怒批“贼喊捉贼”。

Anthropic正深陷多重风暴的中心。

当地时间2月27日,美国总统唐纳德・特朗普表示,他已下令美国所有 *** 机构“立即停止”使用Anthropic的技术。

特朗普在“真实社交”平台发文称,对于国防部等“在不同层级使用Anthropic产品”的机构,将设置六个月的逐步停用过渡期。

特朗普在“真实社交”平台的贴文

特朗普下达命令后不久,美国国防部长皮特・赫格塞思在X平台发文称,因Anthropic拒绝遵守其技术使用要求,他已下令五角大楼将Anthropic“认定为国家安全供应链风险”。

周五晚间,Anthropic发表声明称“我们认为,这一认定既缺乏法律依据,也会为任何与 *** 谈判的美国公司开创危险先例。”

2025年7月,Anthropic与五角大楼签署了一份价值2亿美元的合同,但是该公司希望确保其AI模型不会被用于完全自主武器或对美国民众的大规模国内监控。

五角大楼强烈拒绝了这一要求,并为Anthropic设定了美国东部时间周五下午5点01分的最后期限,要求其同意允许美军将该技术用于所有合法用途。该期限已过,双方仍未达成协议。

赫格塞思在X平台发表声明称:“Anthropic的立场从根本上违背了美国原则。”“因此,该公司与美国武装部队及联邦 *** 的合作关系已被永久改变。”

特朗普在“真实社交”平台发文称:“Anthropic的自私自利正将美国人的生命置于险境,让我们的军队陷入危险,危及我们的国家安全。”

近几周,马斯克在其社交平台X上多次抨击Anthropic,周五发文称该公司“仇视西方文明”。

Anthropic CEO Dario Amodei在2月26日的博文中明确表示,无法接受国防部看似妥协但实则让安全护栏形同虚设的合同条款,并强调Anthropic坚持“两条红线”:不得用于“对美国人进行大规模监控”以及不得用于“完全自主武器”。Amodei写道:“(美国国防部的)这些威胁不会改变我们的立场:我们无法昧着良心同意他们的要求。”

周五, OpenAI表示与Anthropic持有相同的“红线”立场。

OpenAI首席执行官萨姆・奥尔特曼在一份备忘录中写道:“我们长期以来认为,人工智能不应被用于大规模监控或自主致命武器,在高风险自动化决策中,人类应始终参与其中。”OpenAI去年也与五角大楼签署了一份价值2亿美元的合同。

然而,在“硬刚”五角大楼的两天前,始终将安全奉为圭臬的Anthropic对其安全研发限 *** 了调整。

2月24日,该公司低调发布《负责任扩展政策》(Responsible Scaling Policy, RSP)的3.0版本,将此前被视为“硬性红线”的暂停训练承诺彻底删除。之前,这一承诺明确要求模型能力触碰到预设的危险阈值(比如,足以协助生物武器研发的科学理解能力),公司必须暂停训练新模型,直到安全措施跟上。而这道安全防护如今却被替换为以路线图、风险报告与外部评审为核心的透明度机制。这相当于从“做不到就不许动”的刚性约束变成了“边做边说”的灵活框架,拆掉了自我限速的安全之锁。

对此,公司仅解释称,“随着我们逐步接近更高等级的AI安全级别,事先精确界定所需的具体安全防护措施将变得愈发困难。”

实际上,Anthropic的安全底线松动,早有预兆。

2月9日,Anthropic安全部门主管Mrinank Sharma在X平台上宣布离职,并直言在日益增长的经济压力下,公司的部分行为已无法契合其个人价值观,他无法在日常工作中始终如一地践行这些价值观。他在辞职信中写道:“世界正处于危险之中。这危险不仅来自AI或生物武器,而是来自此刻正在上演的一系列相互关联的危机……我反复看到,真正让我们的价值观指导我们的行动是多么困难。我看到了这一点,不仅在我自己身上,也在组织内部,我们不断面临着放弃最重要事物的压力,而且在更广泛的社会中也是如此。”

Mrinank Sharma在X上发布的辞职信

一边是与美国官方的正面“硬刚”,另一边Anthropic却在市场上展开凌厉的产品攻势,成为令一众巨头闻风丧胆的“AI灭霸”。

之一击:法律服务概念股遭“血洗”

1月30日,Anthropic推出一款面向企业法务的AI工具,能够自动处理合同审查、合规检查等核心法律工作。消息在2月3日触发市场恐慌,法律检索服务商汤森路透股价暴跌16%,法律科技公司CS Disco下挫12%,标准化法律服务商LegalZoom大跌20%。

软件股也受到波及,标普500软件与服务指数大跌近4%,高盛编制的一篮子美国软件股下跌6%,后者创下自2025年4月份关税引发抛售潮以来的更大单日跌幅。

第二击:金融数据巨头遭遇暴击

2月5日,旗舰模型Claude Opus 4.6发布。其编码、财务分析、研究和文档处理能力,让金融数据巨头FactSet Research Systems Inc.股价应声下跌7.21%,汤森路透盘中一度跌超8.5%,创2020年3月份以来盘中新低。

市场的逻辑简单而粗暴:既然AI能完成这些工作,为什么还要为传统软件付费?

市场调研机构Analytics Insight指出,越来越多的开发者将Claude等模型直接嵌入自家产品中,这种做法可能削弱传统SaaS厂商在数据分析和研究工作流上的既有优势与用户黏性。

第三击:金融数据巨头“闪崩”

2月21日,能高效扫描代码库漏洞并自动生成补丁的Claude Code Security发布。当天, *** 安全龙头CrowdStrike的股价跌超6.5%,Cloudflare和Okta等随之跟跌,总市值一夜蒸发超100亿美元。Cybersecurity ETF下跌了4.9%,收盘时达到自2023年11月以来的更低点。

第四击:IBM的“噩梦”

2月23日,Anthropic宣布,Claude Code能够自动化完成 COBOL 现代化改造中最复杂的代码探索与分析工作。这直接威胁到了IBM的核心业务之一——大型主机系统。消息传出,IBM股价当天大跌13.2%,创下自2000年10月以来的更大单日跌幅。

短短25天,Anthropic的四次产品发布,精准打击了多个垂直行业的痛点,也让其成为软件业的“AI灭霸”。

国内SaaS行业知名创业顾问吴昊对《每日经济新闻》记者(以下简称每经记者)表示,过去,代码能力是软件行业的重要壁垒,打造一款SaaS产品需要巨额研发投入和长期技术积累,而AI工具的普及让SaaS公司的技术壁垒大幅降低。“以前做一个SaaS产品可能需要融2000万元,雇20人开发一年;现在两个人在车库里用AI工具,两个月可能就做出来了。”

不过,他同时表示,“软件行业不会消失。AI会深刻改造SaaS,使其持续进化,但企业对于流程管理、协同办公等复杂软件的需求将长期存在。除非通用人工智能(AGI)出现,否则当前以人类决策和协作为核心的企业软件模式不会被完全颠覆。然而,AI将提升软件公司的内部效率,并可能导致企业相关岗位的人员减少。”

英伟达CEO黄仁勋也直言,认为AI会取代软件是“不合逻辑的”,AI并非重新发明软件,而是学会使用软件。

在市场对这场关于“颠覆”的讨论达到顶峰时,Anthropic也迅速调转船头,从“破坏者”变身为“合作者”。

2月24日,Anthropic发布了面向Claude Cowork智能体的10款全新AI插件工具,覆盖投资银行、财富管理、HR、私募股权(PE)及工程设计等多个垂直场景。但这一次,它选择与行业巨头并肩而立。其合作伙伴名单上,出现了此前因其产品而股价大跌的FactSet和汤森路透,以及Salesforce、普华永道等公司。

这一战略转向立即获得了市场的积极反馈。汤森路透股价在合作消息公布后,盘中涨幅一度超过14%,创下2008年10月以来更大盘中涨幅;FactSet也上涨了5.9%。

就在Anthropic的技术扩张之际,这家AI独角兽对中国AI技术的指控,又让自己陷入舆论泥潭。

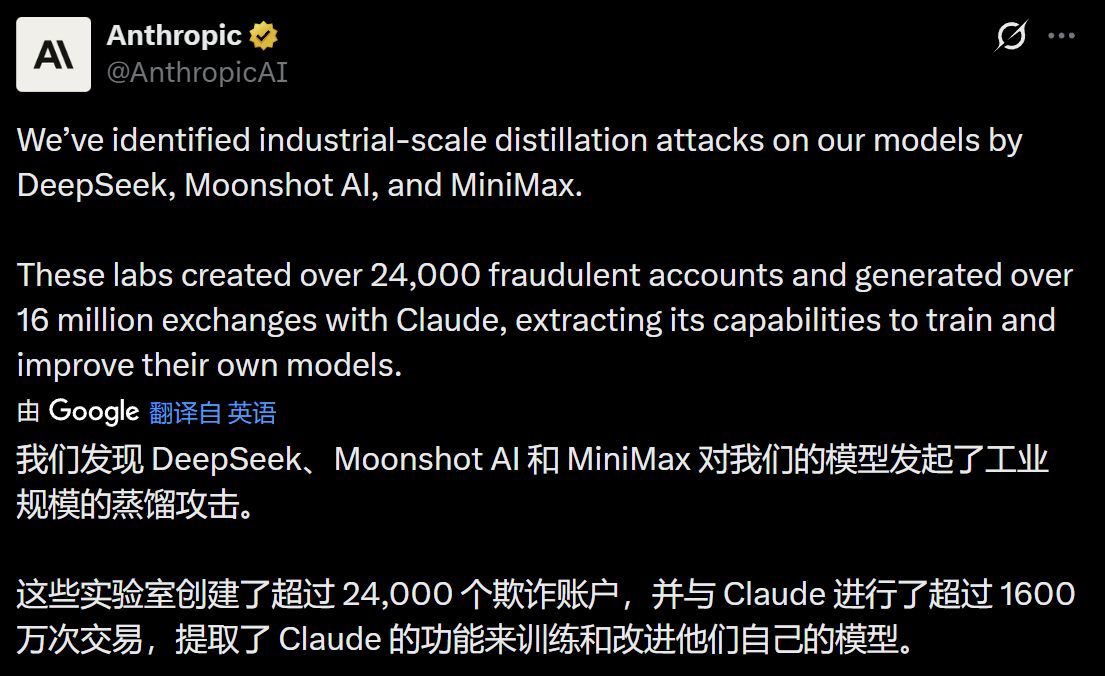

2月24日,Anthropic发布博客文章,高调指控DeepSeek、月之暗面和MiniMax“窃取”其旗舰模型Claude的能力,并称之为“工业规模蒸馏攻击”。

文章声称,这三家公司利用约2.4万个虚假账号,与Claude进行了超过1600万次对话,以训练自己的模型。

然而,这一指控立刻引来了广泛质疑。

伦敦大学学院(UCL)名誉教授、计算机科学家彼得•本特利(Peter Bentley)博士告诉每经记者,“使用大模型来训练小模型并不罕见。在‘蒸馏’过程中,我们利用‘教师’模型产生大量输出,并以此来训练‘学生’模型。这并不是在复制教师模型的内部权重,而是在尝试复现其行为。”

本特利表示,“通过API模型输出训练模型,可以复制行为和模式,但这也取决于新模型的训练质量,它在处理许多输入时可能会表现出与原模型高度相似的行为。由于没有原始模型的训练数据,它永远无法完全克隆出那个模型。通常,新模型还会加入额外的训练数据,所以两者无论如何都不会完全相同。”

实际上,蒸馏技术被全球AI公司普遍使用,包括OpenAI、谷歌、Meta等巨头都在自家模型上应用。就连Anthropic在指控三家中国公司后,补充了一句“蒸馏法是合理的:人工智能实验室利用蒸馏为客户创建更小、更便宜的模型。”

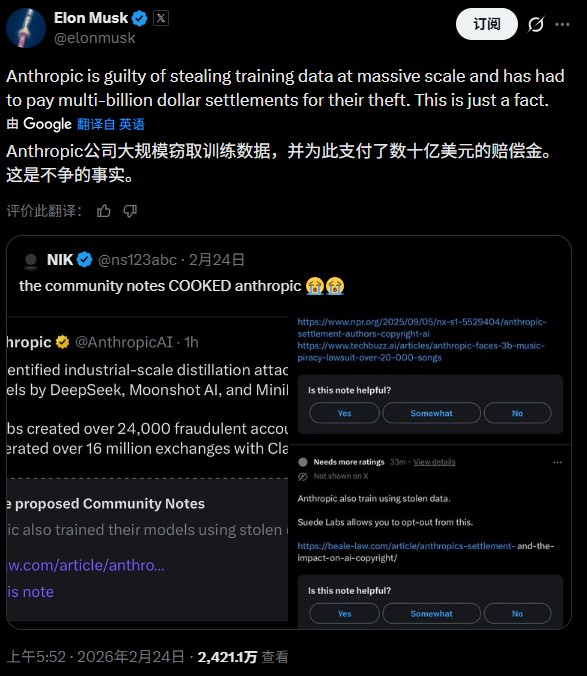

埃隆·马斯克嘲讽Anthropic“贼喊捉贼”。2025年9月,Anthropic因大规模从LibGen、PiLiMi等盗版网站非法下载超700万本受版权保护的图书,并使用这些盗版书籍训练AI模型,被迫向以作家安德里亚・巴茨(Andrea Bartz)为首的全球作家集体支付了15亿美元和解金。

马斯克直言:“Anthropic大规模窃取训练数据,并为此支付了数十亿美元的赔偿金。这是不争的事实。”

在Anthropic指控推文的下方,网友也是猛烈“开炮”:“AI实验室一边通过公开API让别人使用模型,一边又反对他人对其进行蒸馏,这真是极其讽刺”;“‘我可以未经许可使用别人的数据,但谁也别想不打招呼就用我的”“你们训练Claude的时候,不也是用了偷来的数据吗?”

免责声明:本文内容与数据仅供参考,不构成投资建议,使用前请核实。据此操作,风险自担。

封面图片来源:视觉中国-VCG31N2262786367